Le sujet est intéressant car il est transversal (il y a beaucoup de choses interdites à censurer) et compliqué (comment éviter que la censure automatisée ne finisse pas en censure d’usages autorisés). C’est bien sûr le second point qui intéresse les pouvoirs politiques car il permet d’avoir une main mise sur les réseaux de communications. Et la gravité du sujet (des enfants sans défense) cristallise le débat.

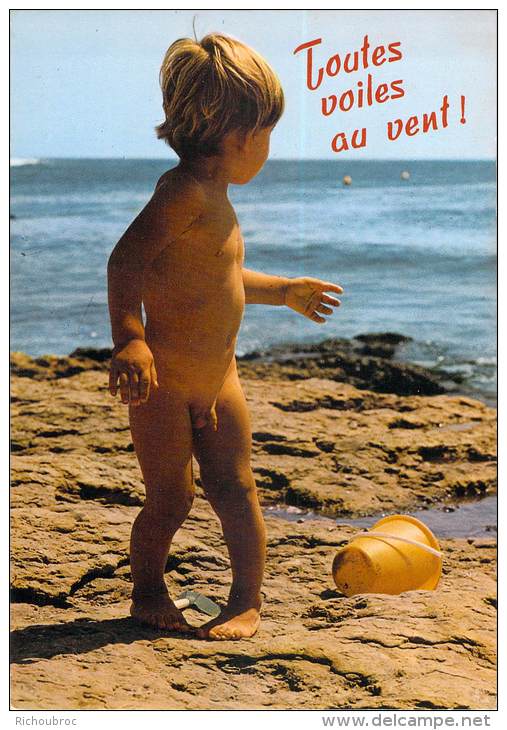

Les photos d’enfants très jeunes comportent souvent des éléments de nudité: fesses, sexe, etc… sans que cela les rendent pour autant pornographiques.

Ces photos sont partagées forcément par les adultes, souvent parents, sans réflexion sur la portée de diffusion de ces photos. Elles sont disponibles au public ou repartagées en chaîne de diffusion sans aucun moyen de contrôle. La preuve en images que j’ai trouvées en quelques secondes archivées sur un moteur de recherche grand public.

Toujours est-il qu’il est donc impossible de construire une détection automatique d’images pédopornographiques en se basant uniquement sur la reconnaissance d’éléments de nudité.

Donc ce que fait Facebook est plus simple, on peut le lire dans ses conditions d’utilisation :

Vous ne publierez pas de contenu incitant à la haine ou à la violence, pornographique, ou contenant de la nudité ou de la violence gratuite.

Voila, c’est interdit, point barre. Vous n’avez pas le droit de partager de photos de vos enfants à la plage.

Autre point de débat. En France, un enfant nu à la plage ne gêne personne. C’est notre culture donc on trouve que cela est une pratique acceptable et à défendre. Mais d’autres pays peuvent avoir d’autres coutumes. Faut il interdire toute photo de femme comme en Arabie saoudite ou tolérer les femmes nues sur la plage comme en Allemagne ?

Où placer le curseur pour une plateforme d’échange mondiale qu’est Internet ?